ICLR 2026,居然有21%的评审是纯纯由AI生成的?!

上面这个相当扎心的答案,来自Pangram实验室的分析报告。

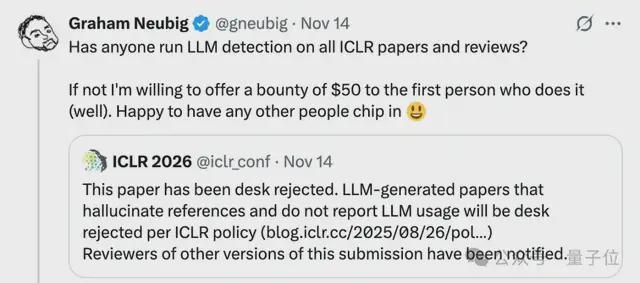

这件事被发现的起因颇具戏剧色彩:CMU的AI研究员Graham Neubig,感觉自己收到的同行评审AI味超级重。

他之所以起疑心,是因为这些评审内容“非常冗长,且包含大量符号”,并且所要求的分析方式并非“审稿人通常在AI或ML论文中所要求的那种标准统计分析方式”。

做事嘛,不能光靠直觉,要真凭实据啦。

Graham Neubig自己干不了这个事儿,就在上发布了一个悬赏令,希望有人能做一轮系统性的检测,看ICLR的论文和审稿中到底夹杂了多少AI文本。

- 我愿意悬赏50美元,给第一个做了这件事的人~

Pangram实验室就是那个接黄榜的。

这个实验室的业务之一,正好是开发检测AI生成文本的工具。

结论简单粗暴:

- 75800条评审中,15899条高度疑似完全由AI生成,占比21%。

- 大量论文正文中也检测出AI参与的痕迹,有的论文甚至大半字数都是AI的产出。

一个顶级AI学术会议,审稿和投稿两头都出现大规模AI代写……

是怎么测出“AI味”的?

Pangram这次对ICLR的全部提交论文和所有评审做了系统分析,并且在博客中公开了全过程。

他们先在OpenReview上,把ICLR 2026的数据全部拉了下来,总计约19490篇论文投稿,以及75800条审稿意见。

这些论文多为PDF格式,普通PDF解析工具面对公式、图表、行号、表格等内容时容易抽风,会干扰后续的文本分析。所以常规的PDF解析器,比如PyMuPDF就用不了了。

于是Pangram用OCR模型(他们用的是Mistral OCR) 把PDF转成Markdown,再统一转成纯文本,尽量减少格式噪音。